近年、消費財(CPG)業界では「購買の自動化」という概念が急速に現実味を帯びてきています。PwCの最新レポート(2025年)では、将来の消費体験が“意識しない購買”が5年以内に普及する可能性を示唆しています。

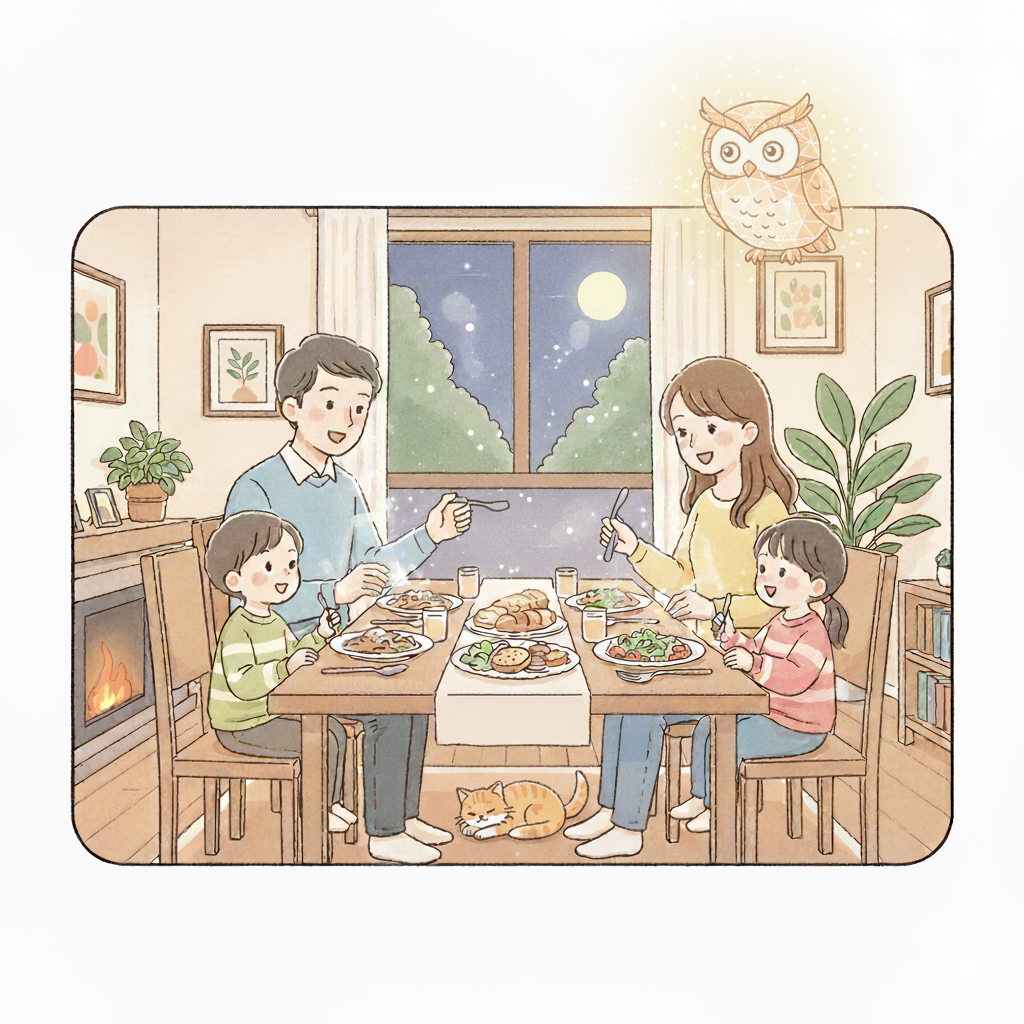

つまり、冷蔵庫やスマート家電がAIと連携し、在庫を自動で把握・発注し、家族の嗜好や健康状態までも踏まえて最適な商品を選んでくれる―そんな世界です。

出典1:PwC「Industry is our edge From shelves to systems: Why the future of consumer goods will be unrecognizable」

https://www.pwc.com/us/en/industries/consumer-markets/library/future-of-cpg.html

一方で、Food Dive誌の報道によると、消費者の多くは購買の自動化に対して「利便性と不安」を同時に感じていることが明らかになっています。AIが「なぜこの商品を選んだのか」を説明できること、そしてユーザー自身が自動化の範囲を制御できることが、信頼の鍵になるというのです。

出典2:Food Dive 「AI is set to transform the way consumers shop for food」

https://www.fooddive.com/news/pwc-ai-food-shopping/802217/

さらに2025年10月、ウォルマートがOpenAIと提携してChatGPTベースのショッピング体験を導入すると発表した際、同社株は過去最高値(2025年10月14日)を更新しました。市場はAIによる購買体験の可能性に大きな期待を寄せています。

しかし、この潮流が加速するほどに、避けて通れない課題が浮かび上がります。

それが、「予期せぬバイアスやアルゴリズム誤判断」です。

出典3:Reuters 「ウォルマート、オープンAIと提携 チャットGPTで直接買い物可能に」

https://jp.reuters.com/markets/japan/KOXGOUSGDJJQZGDNAXHAHSQ4BI-2025-10-14/

1.平均化されたAIが生む「構造的バイアス」

AIによる購買提案は、膨大なデータを学習した結果として生成されますが、その判断はどうしても“平均的”になりがちです。

たとえばAIが「健康的な朝食」を提案しても、宗教上の食事制限やアレルギーを考慮しなければ、それは誤った提案となります。

また、統計的には「節約志向」が主流でも、その家庭が「品質重視」であれば、AIの提案は的外れになるでしょう。

こうしたバイアスは、AIが「個人の文脈」よりも「全体の傾向」を優先して学習することに起因します。

そして購買自動化の領域では、こうした誤判断が“意識されないまま進行する”という怖さがあります。

つまり、ユーザーが知らないうちに、AIが“よかれと思って”不適切な選択を自動実行してしまうのです。

2.解決の鍵は「ローカライズAI」にある

この問題に対して有効なアプローチとして、私は「ローカライズされたパーソナルAI」の概念を提案したいと思います。

それは、クラウド上の汎用AIではなく、個人や家庭単位で学習・調整されるAIエージェントです。

たとえば、Xさん宅のAIは家族構成や健康状態、嗜好、さらには娘のYさんの気分の変化までも理解している。

もしYさんが試験前でストレスを抱えていれば、お菓子の自動補充を控え、代わりにリラックスできるハーブティーを提案する。

あるいは、家族の誰かが風邪気味なら、栄養バランスを重視した食品を優先的に補充する。

このように、ローカライズAIは単なる「購買支援システム」ではなく、家庭の“良識”や“文脈”を理解した倫理的AIパートナーとして機能します。

しかも、この仕組みであれば、AIの誤判断を家庭内で即座にフィードバックし、モデルを修正することが将来的に期待されます。

「この前おすすめされた商品、娘には合わなかった」という一言が、その家庭専用のAIにリアルタイムで反映されるわけです。

結果として、中央集権的AIに比べて、バイアス修正サイクルが圧倒的に短くなる*のです。

*実運用ではデータの偏り・プライバシー/セキュリティ課題・端末の計算制約などがハードルになります。

3.高度なAI処理を要する、もう一つの挑戦

もっとも、ローカライズAIの実現には高い技術的ハードルも伴います。

個人ごとの学習を安全に行うためには、「フェデレーテッドラーニング(分散学習)」や「オンデバイス学習」が不可欠です。(=個人情報を守りながらパーソナライズAIを育てる方法が不可欠です。)

また、家庭内AIが感情や健康状態を読み取るには、言語だけでなく音声・映像・生体信号などを統合するマルチモーダルAIの進化が必要です。

そして、こうした家庭内AIが複数のデバイス(冷蔵庫・スピーカー・スマートウォッチなど)と連携するためには、相互通信のための共通プロトコルや倫理ルールが欠かせません。

さらに、社会的にも次のような課題が生じます。

- 家庭単位の価値観が強化されすぎることで起こる「フィルターバブル化」

- 子どもの意思形成に対して、AIが過剰に“保護者的判断”を下すリスク

- プライバシー保護と利便性のトレードオフ

つまり、技術的進歩だけでなく、「AIがどこまで人間の判断を肩代わりしてよいのか」という倫理的設計思想も並行して進化させる必要があります。

4.購買自動化における現実的な進化シナリオ

このような観点から考えると、購買自動化とローカライズAIの進化は、一足飛びには実現しません。

現実的には、以下のような段階的進化をたどると考えられます。

- クラウド型AIによる購買自動化(現在)

AmazonやWalmartなどが展開する、中央サーバー上のAIによる発注自動化。 - ユーザー設定型パーソナライズ(近未来)

家族構成や嗜好、食事制限などを入力してAIが最適提案をする、半自動型モデル。 - 学習型ローカルAI(次の段階)

家庭内デバイス間でデータを共有し、感情や健康状態も考慮した“自律型エージェント”の誕生。 - 倫理・価値観を理解するエージェント(中長期)

家庭や個人の哲学、倫理観を理解し、購買・生活判断を補助する“家庭AIアドバイザー”の段階へ。

この第4段階こそ、AIが「予期せぬバイアスや誤判断」を自ら検知し、文脈的に修正できる未来像だと考えられます。

5.おわりに:倫理を内包したAIへ

購買の自動化は、もはや「もしも」ではなく「いつ」実現するかの段階にあります。

しかし、便利さと引き換えに人間の意思が曖昧になるなら、それは真の進化とは言えません。

「ローカライズAI」は、私たち一人ひとりの文脈・感情・倫理観を取り戻すための鍵となるでしょう。

それは、AIを人間に似せるのではなく、人間の価値を反映するAIを育てる試みでもあります。

購買自動化の未来を真に持続可能なものにするためには、テクノロジーの進化とともに、「家庭単位のAI倫理」が新たな社会インフラとして整備されていく必要がある。

そうした時代に、私たちはすでに片足を踏み入れているのかもしれません。